ai换脸越发逼真,大模型一本正经胡说八道也难辨真假,新技术带来生产效能的提升却也带来无法忽视的就业冲击……伴随人工智能以越来越快的速度为人类生活与生产方式带来创新和益处,其安全风险也越来越被频繁提起。“以共商促共享 以善治促善智”是2024世界人工智能大会的主题,这两天的各场论坛上,无论是科学家、研究者还是政策制定者、企业家都发出了呼声。这些声音,带着相似的隐忧,传递着“善治”的共识,汇集在一起,形成了“共商”的共振,期待着“善智”的回音。

图说:2024世界人工智能大会上,治理议题升级 来源/新民晚报记者 陈梦泽 摄

治理之“变”

“与传统技术革命不同,人工智能带来的治理冲击具有特殊性。”上海交通大学国际与公共事务学院长聘副教授贾开解释,人工智能引致影响的速度可能远快于传统技术革命,这在很大程度上缘于人工智能技术与整个社会数字化转型进程的互促效应,技术迭代速度快,其嵌入社会、影响社会的过程也极大缩短;人工智能产生影响的结果可能迥异于传统技术革命,就业替代效应或将大于就业创造效应;此外,人工智能产生影响的领域与机制可能是高度不确定的,“尽管我们大致能框定人工智能安全风险类型,但风险产生的时间地点、对象范围、因果过程等都是未知的,并甚至不能被提前预知。”

“人工智能技术和应用的不确定性与复杂性,使得从业者和监管者不得不面临‘共同无知’,治理问题的界定与治理方案的探索始终处于动态变化之中,”清华大学文科资深教授、苏世民书院院长薛澜更是冷静地强调了人工智能治理的新挑战,“同时,治理主体在文化、伦理、价值观等各个维度都存在较大异质性,风险偏好的差异使得达成治理共识较为困难;治理与发展要求同步演化,以避免出现‘监管洼地’,但治理更新的速度却往往落后于技术创新和应用步伐。”

清华大学公共管理学院长聘副教授赵静也观察到ai治理议题正快速变化,她认为这与人工智能技术本身的快速成长性和应用不确定性密切相关,尤其是随着人工智能技术在经济社会中的全面应用提速,除了对各类潜在风险的关注外,技术发展和应用对人类普遍生存的安全影响被提上日程。“现在大家更关心如何构建一个安全可信的人工智能发展框架、基础理论、治理思路,从而应对和解决前沿人工智能发展背后的基本安全问题。”

图说:面对ai治理“共同无知”是现实,也是政、产、学、研形成共识实现共商的原因 来源/采访对象供图(下同)

应变之策

阿里研究院执行院长袁媛认为,正是因为这种相似境遇,科学家、企业、政府形成了一种自觉的共识,逐渐形成了磨合共治的协作模式,大家共同面对问题,合作形成公共知识,再各自改善。

这种共识并非与生俱来。袁媛提到,在电商时代应用判别式人工智能技术时,无论平台、商家、用户、社会都需要安全交易,需要建立“生态信赖”,阿里巴巴就认识到用算法参与治理的重要性,从企业内部启动了治理进程。“那算是治理初期,市场上的企业没有太多共识,治理模式也相对简单,企业处于‘被规制’的角色。而现在,随着公众认知提升,产业接受度提高、政府期待日渐成熟,各方将逐渐对‘善智’形成更为健全的共识。”

升级治理模式并非易事。上海国际问题研究院研究员、网络空间国际治理研究中心秘书长鲁传颖表示,20世纪80年代美国学者曾提出科林格里奇困境——政策制定者面对快速发展的技术存在“太早治理因噎废食,太晚治理脱缰失控”的困境,“所以建立沟通模式,寻找恰到好处的时机,以敏捷治理等最小成本最大收益的方式开展良好治理是很重要的,目前中国正在寻找好的模式、机制、节点。”

贾开也认为,人工智能治理不能遵循传统技术治理范式按照预先确定规则来加以管控,而更加需要依赖政、产、学、研的共同探索,并在此过程中积累治理知识、能力、资源。此次会上,上海交大联合、徐汇区政府及研究机构、媒体等21家单位共同发起“西岸对话:人工智能安全与治理对话网络”,旨在打破壁垒,在共商共建共治过程中共同探索、共同进步,通过对话机制、建设平台渠道、素养提升等常态工作,促进各方在人工智能安全与治理领域的紧密合作,以期在快速发展的人工智能时代中更好地统筹发展与安全。贾开认为类似“西岸对话”的共商共建共治机制才能实现ai治理升级的价值,“在单独一方都不知道人工智能治理风险内涵及其应对机制的前提下,只有保持开放对话的治理关系,才可能形成科学共识、找到合适的治理方法。”

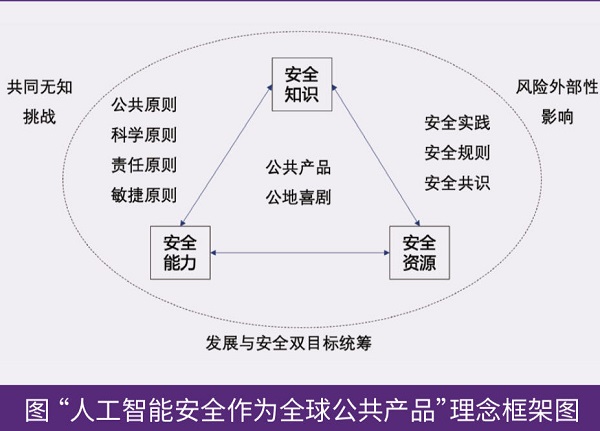

图说:2024世界人工智能大会上,“人工智能安全作为全球公共产品”的治理理念被首次提出

中国呼声

人工智能治理是全球议题,当前国际社会对人工智能治理既有建立实体多边监管的联合国模式,也有部分欧美国家开展的小范围联盟式治理探索。鲁传颖认为,这场实践中,中国正全方位积极参与人工智能国际治理,并设计了一条不同于西方国家的治理思路。去年中国政府发布《全球人工智能治理倡议》,围绕人工智能发展、安全、治理阐述人工智能治理中国方案。鲁传颖指出,中国方案强调人工智能发展必须坚持“以人为本”理念,提倡更为和谐、平衡的人类关系视角,倡导构建一个平衡各方利益、共同应对人类挑战的全球人工智能治理新模式。

“不同模式在当前非常需要对话与互补,因为人工智能的影响是‘生态性’的,任何一方都不可能完全排除他方,所以存在形成合作共识的基础。”上海交通大学政治经济研究院名誉院长、广州粤港澳大湾区研究院理事长郑永年谈到,“当前尽管仍然存在分歧,中美、中法之间都在人工智能领域展开积极对话,只有在坚持开放、对话、合作基础上,我们才有可能提升人工智能国际治理水平,在未来能形成具有约束力、执行力的合作共识。”

大会期间,科学家从技术视角提出了一些新的治理理念和路径。“应将人工智能治理视为一类‘知识’和‘行动’并进的公共产品。”薛澜提出,这类公共产品具有非排他性,即所有从业者都应服从相关规制;同时,这类公共产品也具有非竞争性,即治理方案的扩散和运用不影响他者对该方案的享用。

斯坦福发布的《人工智能指数报告》中,中国连续两年成为ai信任度最高的区域。袁媛认为,这说明目前中国的ai治理和企业自律都有较好的表现。她期待接下来,企业、政府、研究机构等第三方共同制定安全规范,媒体公众参与监督,大家一起把事情做好。“市场是最好的大考场,君子之过如日月之食,谁出错都在聚光灯下。”她还建议,为营造更为向善的生态,应采用激励与监管相融的方式,对安全治理方面投入更多的企业予以激励。

新民晚报记者 易蓉

图说:人类与ai的和谐未来,“善治”共识期待“善智”回音 来源/新民晚报记者 陶磊 摄

【观点集锦】

图灵奖得主、中国科学院院士姚期智:有两个系统性的ai安全治理方向——有益的通用人工智能和可证明的安全通用人工智能。前者由博弈学角度出发,让ai与人类利益对齐,强调机器人应该以人的利益为本,保持对人的需求的了解;后者则是用校对检查的方式来设计数学上绝对安全的系统,让人类只和可证明安全的“白盒子”交流。

清华大学公共管理学院长聘副教授赵静:人工智能安全的共识达成,不仅需要多元利益相关者的充分交流和对话,更重要的是先形成全球各界的信任文化,达成关于安全的红线共识。

阿里研究院执行院长袁媛:人工智能治理对企业来说当然是一种束缚,但是,如同飞机、汽车的安全带,越是极速发展越需要安全防护。生成式人工智能阶段,ai不局限于单一任务,越来越具备类人模式,就更需要企业自律,同步安全与发展。目前阿里的ai治理路径已经内化在模型开发、融入于训练阶段。我们希望“培养聪明的ai”,就像人越聪明,越有鉴别错误和规避风险的能力,模型越强,安全性越高。

星环科技研发总监许喆:在数据资产和语料体量巨大的当下,传统的纯工具管理方式已不再适应快速发展的业务需求。星环在大数据开发工具中引入智能化和自动化的“盘点”功能,能对元数据进行采集,识别数据资产,并补充业务语义,提升数据资产的可见性和可管理性,也为数据治理提供了基础。

上海交通大学国际与公共事务学院副教授秦川申:将人工智能安全治理的科普工作纳入到高等教育中是关键一步。再加上人工智能安全治理培训以及相关伦理资质的认定、公民人工智能素养培养,面向这三个群体的教育工作加起来,才能在专业教育、行业底线、全民素养上形成人工智能安全治理的合力。

新民晚报记者 易蓉 马丹 整理

【相关链接】